NHẬN DẠNG CỬ CHỈ TAY BẰNG RA-ĐA FMCW DỰA TRÊN MẠNG NƠ RON TÍCH CHẬP KẾT NỐI CHÉO

457 lượt xemDOI:

https://doi.org/10.54939/1859-1043.j.mst.75.2021.15-22Từ khóa:

Mạng nơ-ron tích chập; Nhận dạng cử chỉ tay; Ra đa FMCW; Phổ micro-Doppler.Tóm tắt

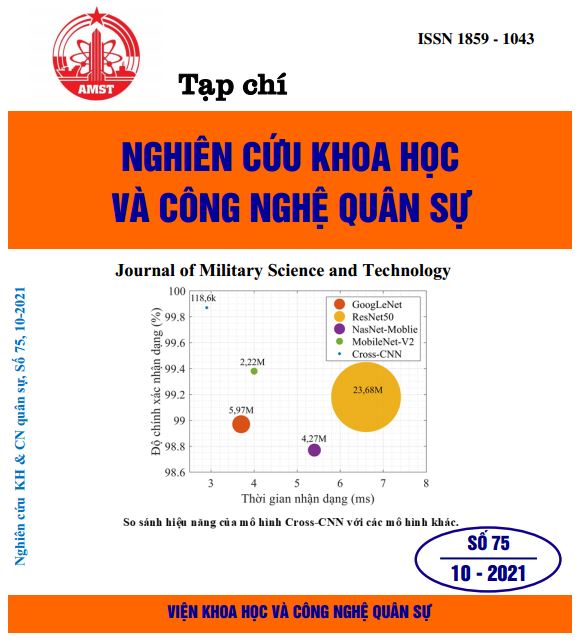

Nghiên cứu này đề xuất sử dụng mạng nơ-ron tích chập kết nối chéo (Cross-CNN: Cross-connection Convolutional Neural Network) để nhận dạng cử chỉ tay dựa trên dữ liệu phân tích phổ Doppler vi mô (micro-Doppler) của ra-đa FMCW (Frequency Modulated Continuous Wave). Thêm vào đó, các mức nhiễu khác nhau được thêm vào dữ liệu để đánh giá đầy đủ hơn đối với mô hình đề xuất. Kết quả thử nghiệm cho thấy, mô hình được huấn luyện với dữ liệu có nhiễu cho chất lượng nhận dạng tốt hơn mô hình được huấn luyện với dữ liệu không có nhiễu. Sau đó, mô hình Cross-CNN được phân tích, đánh giá khi thay đổi các tham số cấu trúc, từ đó chọn ra bộ tham số phù hợp nhất cho bài toán đề ra. Cuối cùng, mô hình Cross-CNN được đánh giá, so sánh với các mô hình hiện có khác khi thực hiện trên cùng một tập dữ liệu. Kết quả là, mạng Cross-CNN cho khả năng nhận dạng cử chỉ tay tốt hơn các mô hình khác nhờ vào các kết nối chéo cho phép sử dụng kết hợp các đặc tính cũ với đặc tính mới trong quá trình huấn luyện mạng.

Tài liệu tham khảo

[1]. X. Zabulis, H. Baltzakis, and A. A. Argyros, “Vision-based hand gesture recognition for human–computer interaction,” in The Universal Access Handbook. Boca Raton, FL, USA: CRC Press, 2009.

[2]. S. Ahmed, K. D. Kallu, S. Ahmed, and S. H. Cho, “Hand Gestures Recognition Using Radar Sensors for Human-Computer-Interaction: A Review,” Remote Sensing, vol. 13, no. 3, p. 527, Feb. 2021.

[3]. [Online] Available: https://atap.google.com/soli.

[4]. M. Scherer, M. Magno, J. Erb, P. Mayer, M. Eggimann and L. Benini, "TinyRadarNN: Combining Spatial and Temporal Convolutional Neural Networks for Embedded Gesture Recognition With Short Range Radars," in IEEE Internet of Things Journal, vol. 8, no. 13, pp. 10336-10346, 1 July1, 2021.

[5]. M. G. Amin, Z. Zeng and T. Shan, "Hand Gesture Recognition based on Radar Micro-Doppler Signature Envelopes," 2019 IEEE Radar Conference (RadarConf), 2019, pp. 1-6.

[6]. M. Ritchie, R. Capraru, and F. Fioranelli, “Dop-NET: a micro-Doppler radar data challenge,” Elec-tronics Letters, vol. 56, no. 11, pp. 568–570, May 2020.

[7]. Q. Zhang, “Micro-Doppler Characteristics of Radar Targets”, Kidlington, United Kingdom: Butterworth-Heinemann, 2016.

[8]. A. Zhang, Z. C. Lipton, M. Li, and A. J. Smola, “Dive into Deep Learning”. 2019.

[9]. K. Janocha and W. M. Czarnecki, “On Loss Functions for Deep Neural Networks in Classification,” Schedae Informaticae, vol. 1/2016, 2017.

[10]. S. Ruder, “An overview of gradient descent optimization algorithms,” arXiv:1609.04747v2, online [Available] https://arxiv.org/abs/1609.04747, 2016.

[11]. C. Szegedy et al., “Going Deeper with Convolutions,” arXiv:1409.4842v1 17 Sep 2014. [Online] Available: https://arxiv.org/pdf/1409.4842.pdf.

[12]. K. He, X. Zhang, S. Ren, and J. Sun, “Deep Residual Learning for Image Recognition,” 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2016, pp. 770-778.

[13]. B. Zoph, V. Vasudevan, J. Shlens and Q. V. Le, “Learning Transferable Architectures for Scalable Image Recognition,” 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2018, pp. 8697-8710.

[14]. M. Sandler, A. Howard, M. Zhu, A. Zhmoginov, and L.-C. Chen, “MobileNetV2: Inverted Residuals and Linear Bottlenecks,” IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2018, pp. 4510-4520.